robots.txt

robots.txtとは

robots.txtは、ウェブサイトの管理者が検索エンジンのクローラーに対してクロールの許可や禁止を指定するためのテキストファイルです。このファイルはウェブサイトのルートディレクトリに配置され、クローラーがページのどの部分をクロールするか、またはしないかを指示します。特定のページを検索エンジンにインデックスさせたくない場合や、リソースのクロールを制限したい場合に役立ちます。

robots.txtの基本構造

robots.txtファイルはシンプルなテキストファイルで、主に以下のような要素で構成されています。

- User-agent

どのクローラーに対する指示かを示します。特定のクローラー向けにルールを設定する場合は、例えば「User-agent: Googlebot」と指定し、全てのクローラーに共通の指示を出す場合は「User-agent: *」と記述します。 - Disallow

クローラーにアクセスを禁止するURLパスを指定します。これにより、指定されたページやディレクトリが検索エンジンにクロールされるのを防ぐことができます。 - Allow

特定のディレクトリ内で一部のファイルやフォルダのみクロールを許可するために使用します。

robots.txtは非常に簡潔な構造であり、ユーザーが設定したルールに基づいてクローラーの動作を制御します。

robots.txtの代表的な記述例

以下にrobots.txtの記述例をいくつか挙げます。

-

全てのクローラーに対して全ページを許可する場合

User-agent: * Disallow:この設定により、すべてのページがクロールされます。

-

全てのクローラーに対して全ページのクロールを禁止する場合

User-agent: * Disallow: /これは、ウェブサイト全体のクロールを停止したい場合に使用されます。

-

特定のディレクトリのみをクローリング禁止する場合

User-agent: * Disallow: /private/この例では、/private/ディレクトリ以下のページがクロールされないように指示しています。

-

特定のファイルにアクセスを制限する場合

User-agent: * Disallow: /sample-page.htmlこの場合、/sample-page.htmlのみがクローリングの対象外となります。

これらのルールを組み合わせることで、サイトの各部分に対して適切なアクセス制限をかけることが可能です。

DisallowとAllowの使い分け

DisallowとAllowは、クロールを制御する上で非常に役立つ指定です。たとえば、「/images/」ディレクトリのすべてのファイルをクロール禁止にしつつ、特定の画像だけをクロールさせたい場合に利用します。

例:

この記述により、imagesディレクトリ内の「public.jpg」だけがクロールされ、その他の画像はクロールされません。

複数のUser-agentとDisallowの指定方法

robots.txtでは、複数のUser-agentやDisallowを指定することも可能です。たとえば、Googlebotに対しては特定のディレクトリのみをクロール禁止にし、その他のクローラーには全てのコンテンツを許可する設定ができます。

例:

ここでは、Googlebotには「/restricted/」ディレクトリが禁止され、その他のクローラーには特に制限が設けられていません。

sitemapの指定方法

robots.txt内でサイトマップの場所を指定することも可能です。これは、検索エンジンに対してサイトの構造を理解させるために役立ち、クロールの効率を向上させる手助けとなります。

例:

robots.txtとnoindexの違い

robots.txtはページのクロールを制御しますが、インデックスの有無には直接影響を与えません。特定のページがインデックスされるのを避けたい場合、robots.txtではなくHTMLの<meta name=”robots” content=”noindex”>タグを使用します。このタグを用いると、検索エンジンにそのページをインデックスしないよう指示できます。ただし、ページ自体のクロールも避けたい場合には、両方の方法を併用する必要があります。

SEOにおけるrobots.txtの効果

robots.txtはSEOにも間接的に影響を与えることがあります。クロールの際に必要なページのみを許可し、不要なページを制限することで、クローラーのリソースを効率的に利用できます。特に、大規模なサイトではクロールバジェットの管理が重要であり、robots.txtを適切に設定することで検索エンジンにとって有用なページを確実に巡回させることができます。

また、robots.txtはGoogleなどの検索エンジンにとってのリクエストですが、クローラーが必ずしも従うわけではない点も理解が必要です。

よくある質問

📕 robots.txtファイルはどのような目的で使用されますか?

📖 robots.txtファイルは、検索エンジンのクローラーがウェブサイト内をどのようにクロールするかを制御するために使用します。このファイルには、クロールの許可や制限を記述でき、DisallowやAllowといったディレクティブを用いて特定のページやディレクトリへのアクセスを制限することができます。また、SitemapのURLを記述することで、クローラーにインデックスさせたいページを効率的に案内できます。適切な設定はSEO対策にもつながります。

📕 robots.txtファイルの書き方や設置時に注意すべき点は何ですか?

📖 robots.txtファイルを作成する際は、意図しないページのクロール制限を避けるよう慎重に記述することが大切です。ディレクティブの書き方に誤りがあると、検索エンジンが重要なページをクロールしなくなる可能性があります。また、ファイルはサイトのルートディレクトリに設置する必要があり、テスターを使って設定が正しく動作するか確認することを推奨します。特にnoindexディレクティブはrobots.txtでは機能しないため、metaタグでの設定が必要です。

📕 robots.txtファイルの記述内容を変更した場合、検索エンジンへの影響はありますか?

📖 robots.txtファイルの記述を変更すると、クローラーがクロール対象とするページが変わるため、検索エンジンへの影響が生じます。例えば、Disallowで特定のディレクトリをクロールから制限すれば、そのディレクトリ内のページはインデックスされなくなります。ただし、記述の変更が適用されるまでに時間がかかる場合があります。また、設定変更後はGoogle Search Consoleなどで「robotsテスター」を使用して、クローラーが正しく動作しているかを確認することが重要です。

SEO対策でお悩みの方へ

無料で資料をダウンロードいただけます!SEO対策に役立つノウハウや具体的な施策、最新の成功事例をまとめた3つの資料をご用意しました。これからSEOに取り組む方にも、すでに実践中の方にもお役立ていただける内容です。

資料を無料でダウンロードドメイン診断レポートをご希望の方へ

無料でドメイン診断レポートをダウンロードいただけます!あなたのドメインの強みや改善点を明確にするための詳細な分析レポートをご用意しました。初心者から上級者まで、幅広い方に役立つ内容です。

ドメイン診断レポートを無料でダウンロードまずは簡単お見積り

あなたのサイトに最適なSEO対策をご提案します。検索順位の向上やアクセスアップにお悩みの方は、今すぐお見積りフォームからご相談ください。初めての方でも安心してお任せいただけるサポートをご提供します!

SEO簡易お見積りフォーム支援実績

株式会社viviONとの取り組み

株式会社ワンズマインドとの取り組み

株式会社メディカルフロンティアとの取り組み

株式会社キャリアデザインセンターとの取り組み

GMOインターネット株式会社との取り組み

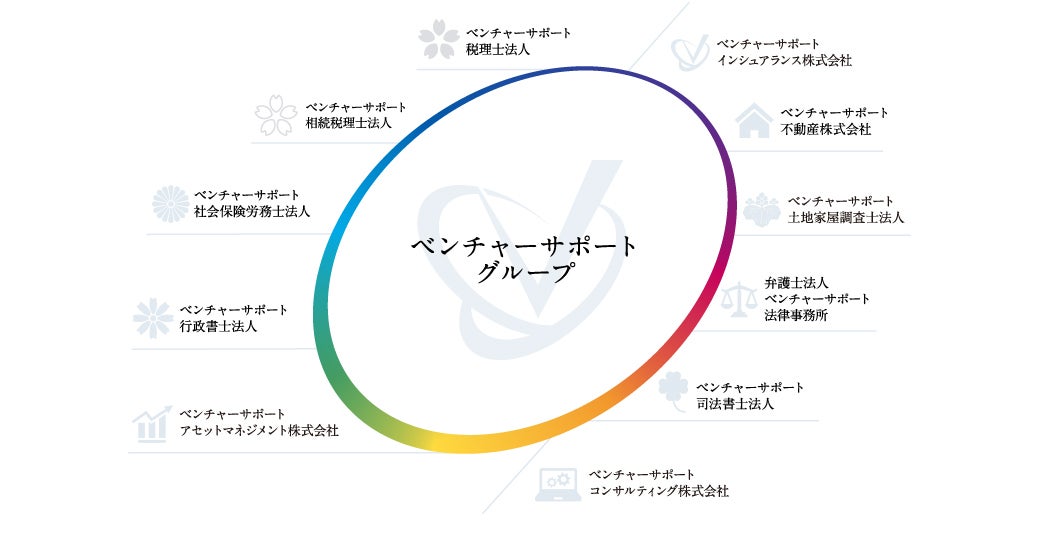

ベンチャーサポートコンサルティング株式会社との取り組み

株式会社幻冬舎ゴールドオンラインとの取り組み

株式会社アップルワールドとの取り組み